これまでの記事はこちら

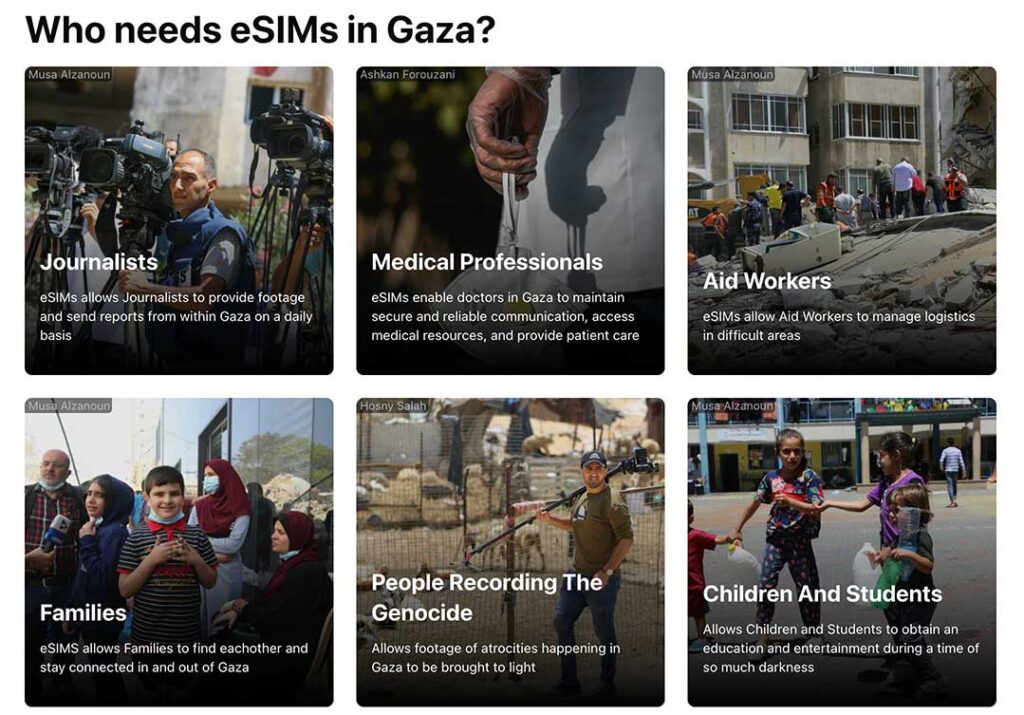

2023年5月、全米摂食障害協会(NEDA)のヘルプラインで使用されていた「テッサ(Tessa)」というチャットボット(自動応答システム)が、導入からわずか1週間で閉鎖された。体重が増えることへの不安や恐怖から食べ物を拒否する人に適切なアドバイスをすべきチャットボットが、カロリー減や体重減を勧めるなど、摂食障害を悪化させるような回答をしていたことがわかったからだ。このヘルプラインは20年以上にわたり少数の職員とボランティア、つまり人間によって運営されていた。しかし職員は解雇され、その仕事はチャットボットに取って代わられていた。

テッサが有害な回答をしていたことは、摂食障害の当事者からの声がきっかけとなりSNS上で炎上。これを受け心理学者や医師など複数の専門家がテッサの動きを問題視することになった。NEDAはテッサの不適切な回答を認め閉鎖させるに至ったが、なぜこうした回答が生み出されたのかは誰にもわからないままだ。

AIの「シートベルト」としての監査

AIが急速に社会に実装される中、AIが予期せぬ誤作動をしたり、差別や人権侵害を引き起こしたりしてきた事例も数多く報告されてきた。例えば、Amazonが人材採用時に使用していたAIが女性に不利な結果を出力していたことが判明(2018年)、ゴールドマン・サックスのAIは女性に不当に低い信用スコアをつけていたためクレジットカード限度額に差が生じていた(2019年)。英国の資格・試験統制機関オフクァルのアルゴリズム成績予測評価は、労働者階級やマイノリティに帰属する生徒に不利な評価を下すことも報告された(2020年)。冒頭の「テッサ」もこうしたケースの一つだといえる。

AIが学習するデータセットは私たちの生きる現実世界の差別や偏見を反映しており、その結果、人種や性別、階層などの属性に基づく差別が再生産されてしまう。政府・自治体もAIを広く導入するようになった現在、教育や医療、福祉などの公共サービスの提供時に差別や偏見に基づく結果が生じてしまえば大問題になる。

このようにAIがもたらす負の側面が明らかになり、倫理の課題や社会への影響がより重視されるようになるにつれ、AI/アルゴリズムの監査が注目されるようになった。アルゴリズムが設計通りに機能しているか、誤作動はないか、差別や有害な結果をもたらしていないかなどを評価・検証するのが監査の役割だ。特にチャットGPTが登場した2022年以降、生成AIの監査も急速に拡大し始めている。クライアントは企業や政府機関、自治体である場合が多く、監査を行なうのはコンサルタント企業や技術者、研究者などだ。監査の必要性は国際的にも認識され、研究者や実務者によるアルゴリズム監査研究と呼ばれる研究領域も急速に広がっている。

「私たちの生活は、住宅ローンや大学進学、就職、医療へのアクセスなど、繊細で重大な決定を下すテクノロジーであふれています。これらを判断するAIシステムは、制御や監視の仕組みがないまま行なわれていることがよくあります。例えば、自動車のシートベルトを想像してみてください。自動車が発明された当時はシートベルトがなく、多くの命が失われました。そこで命を守る対策としてシートベルトが発明され、長年の社会的な議論を経て技術基準が確立され、法的にも義務化されました。アルゴリズム監査は、AIが公正で透明性のある方法で私たちに役立つことを保証するためのシートベルトであるべきです」

スペイン出身のジェマ・ガルドン・クラベルは、アルゴリズムと倫理の課題を専門とし、欧州委員会の上級顧問も務めた技術政策アナリストだ。彼女は10年ほど前からAI/アルゴリズム監査の専門家として欧州をはじめ国際的に活躍している。

確かに、自動車や食品には厳しい安全性評価や規制が確立され、これをパスしなければ市場に並べることはできない。だがAIについては事前審査や影響評価などの基準はまだ存在せず、社会に実装されて初めてそのリスクが明らかになる。

実のところ、AIを生み出した開発者自身でさえ、AIがもたらす様々な影響を正確に把握しきれていないのだ。だからこそ監査の重要性があるとクラベルは言う。